目次

監視社会

わたしたちは普段色んなカメラに接して生活しています.一日生活してみていくつのカメラが自分の周りにあったか数えることができるでしょうか?スマートフォンやPCのウェブカメラなどの意識しやすいものもあれば,監視カメラなどの普段あまり意識しないものまで様々です.

ここではその意識しない側の存在である監視カメラについて考えてみたいと思います.

CCTV

CCTVとはイギリスの監視カメラシステムです.現在イギリス全体で約600万台の監視カメラが存在します.イギリスより国土の広い日本はその1/100程度の監視カメラがあるようですが,それでも多いように感じる方もいるかもしれません.

もともとは防犯目的でイギリス政府が推進してきたプロジェクトで,ロンドン同時多発テロなどを契機にかなり拡大したようです.これが犯罪の抑止力になるかどうかという議論はさておき,このような徹底的に監視された状況で一市民として何を感じるでしょうか.

Pros

- 犯罪に遭う確率が減って嬉しい

- 犯罪に遭っても犯人が見つかる確率が上がって嬉しい

Cons

- カメラの死角はより危険な場所になるのではないか

- 防犯以外の目的で記録されているのではないかと不安になる

- ちょっとした交通違反などでも徹底的に監視されて気が抜けない

など,色々なことが想定されると思います.

近年,AIベースのコンピュータビジョンの発達によって,より高度な分析がなされていることは間違いありません.

この状況を踏まえた上で,どのように生きていくかという問題を各々が考えていく必要があるかもしれません.

監視と表現

監視カメラ・プレイヤーズ

監視カメラ・プレイヤーズ(SCP)は,1995年にマイケル・カーターが行った「ビデオ監視装置のゲリラ・プログラミング」の呼びかけに応じて,1996年11月にビル・ブラウン、スーザン・ハル,その他様々な活動家がニューヨークで設立したグループです.このメディア・アクティビスト・グループのメンバーは,カメラの前で特別に脚色された芝居を上演することで,保護されているプライバシーの侵害に反対することを表明しています.アルフレッド・ジャリの「ユビュ・ロイ」やオーウェルの「1984」,ベケットの「ゴドーを待ちながら」などが上演されました.それ以来,このメディア・アクティビスト・グループは,主にニューヨークで40回以上監視カメラの前でパフォーマンスを行っており,現在ではテンピ,アリゾナ,サンフランシスコ,ボローニャ,ストックホルム,リトアニアにもグループがあるそうです.

もともとはテレビ番組で警備員が監視カメラの映像を見て暇をつぶすというコンテンツにインスパイアされたものらしいですが,警備室のカメラを「観客がいる」リアルタイム配信カメラのような捉え方をすることで,見る-見られる関係性を強く意識させ,同時にパフォーマーが自分が見られているということを自覚していることがよく伝わってきます.

データセットとプライバシー

大量の画像をデータセットとして学習するプロセスを経ることで,AIが高次元の特徴を捉えられるようになるということがわかりました.しかし画像を集めようにも,著作物の無断のダウンロードや使用は禁止されているため,既存の絵画を学習して新しい絵画を生成したりすることは難しいように思います.

実は,著作権法47条の7では情報解析(深層学習含む)目的では自由に著作物を使用できる旨が記されています.しかも,商用であっても可能です.

今後深層学習に取り組むことがある場合は,利用範囲に注意しつつ慎重にデータを集めるようにしましょう.

みなさんが使うサービスには,今後のサービス向上のためのユーザー情報の提供の同意確認がよくあります.

このように個人情報などを含むデータは厳重に扱われています.

しかし,一度SNSやウェブサイトにアップロードされた写真や個人情報は誰でも閲覧可能です.

アメリカではClearview AIという企業がスクレイピングにより収集した顔画像などのデータが,FBIをはじめとする多数の法執行機関によって利用されてることがわかりました.

I Got My File From Clearview AI, and It Freaked Me Out

なにげなく利用しているSNSからかなり詳細なデータが収集されていることが現実に起きている現在,これらのテクノロジーとの付き合い方について再考してみても良いかもしれません.

AIを誤用する

誤検出させてみる

以下のOpenCVベースのプログラムをスマホのウェブブラウザで開き,顔ではないのに顔として検出されてしまうものを探してきましょう.

要件

- 赤い四角が見える状態にすること

- 人間以外の対象であること

誤検出させる

REALFACE Glamouflage

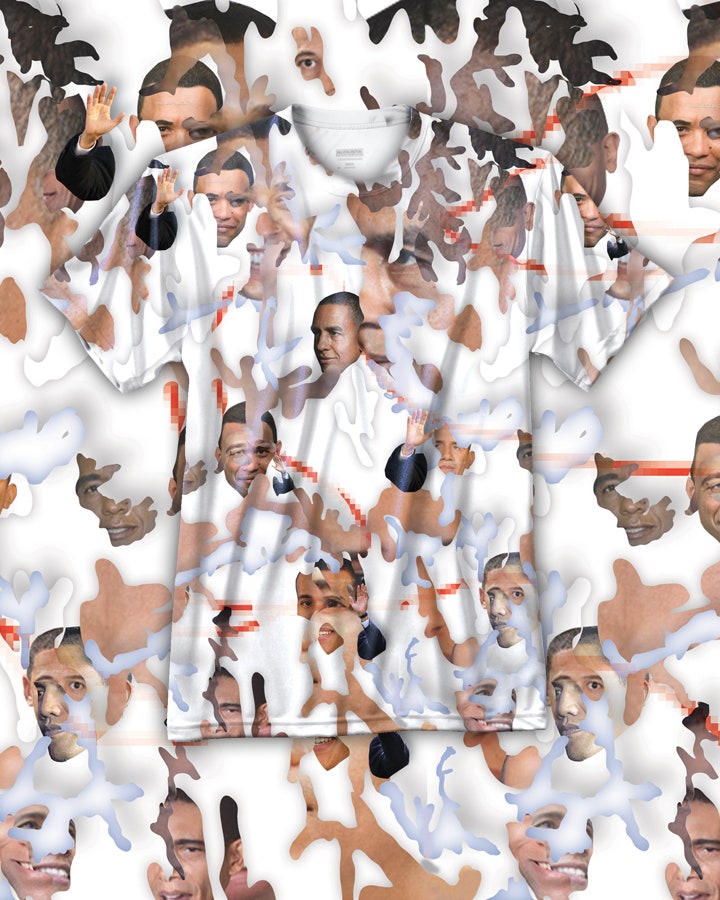

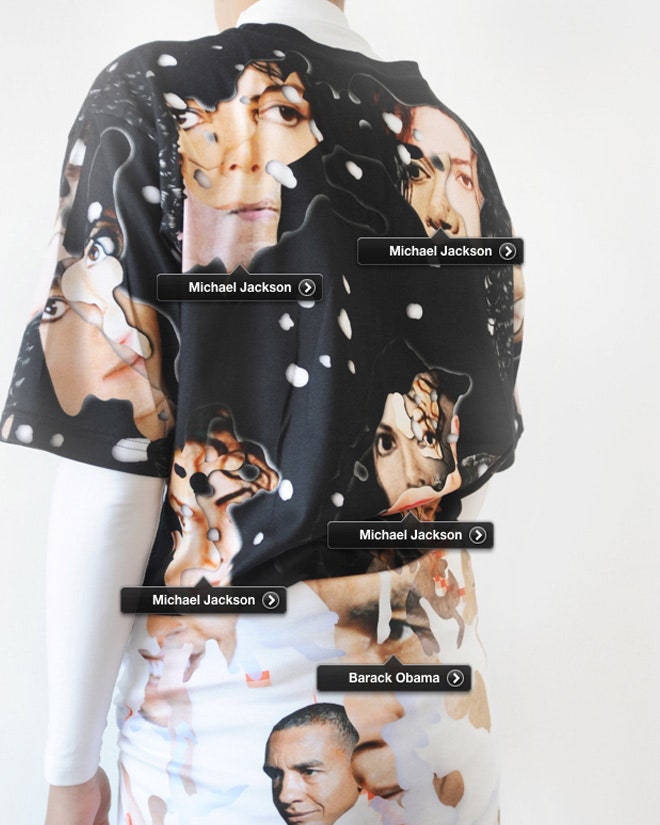

REALFACE Glamouflageは,顔認識アルゴリズムを混乱させるように設計されたTシャツのコレクションです.

この作品の当時,Facebookにおける写真のタグ付け機能が流行していました.この機能は,画像をアップロードするだけで個人を識別しタグ付けしてくれるという便利な機能ではありますが,そのアルゴリズムの詳細については明らかになっていません.かつては写真にタグを付けるという行為は,自らが能動的に行う行為でしたが,この機能が開発されて以降は,Facebookの提案を受け入れるという受動的な行為へと変化していきました.

かつては任意の機能としてタグ付け機能が存在していましたが,Facebookによる自動タグ付けが普及して以降は,以前にも増して顔というものがある種の価値を持つようになりました.タグ付けされることでプロフィールにも表示されやすくなり,「いいね」も集めやすくなります.元々SNSに顔写真をアップロードすることはリスクも孕んでいましたが,自動タグ付けによってアップロード行為は促進されることにも繋がりました.

そのような背景の中で,REALFACE GlamouflageはFacebookの顔認識アルゴリズムを混乱させることを目的として制作されました.以下のように,有名人の顔画像をTシャツに貼り付けることで,顔認識アルゴリズムはそれらの画像を顔として認識し,余分なタグを付与します.

このTシャツを着ることで余分なタグが付与され,着ている人の情報はある程度分散させることができます.顔認識アルゴリズムを混乱させることで,個人のプライバシーを守ることができているわけです.顔認識アルゴリズムが一般に普及した現代の社会においては,このようなデザインが自らの身を守る役割を果たすのかもしれません.そのようなアルゴリズムから身を守るにはどうすれば良いのか,その解決策について私たちに導線を与えてくれるような作品です.

(画像は https://www.designforsustainability.info/signals/realface-glamouflage より引用)

検出から逃れてみる

以下のOpenCVベースのプログラムをスマホのウェブブラウザで開き,映り込む自分自身の見た目を変化させることによって,自分の顔が認識されなくなるように工夫してみましょう.

要件

- 認識されている証拠である赤い四角が見えない状態にすること

- 本人であることは認識できるようにすること

検出から逃れる

UNLABELED

次に,AIに抵抗するプロジェクトの一例として,UNLABELEDというプロジェクトを紹介します.このプロジェクトは,一言で言えば,AIの検出から逃れる服を作るプロジェクトです.

近年では,様々な場所に監視カメラが設置され,私たちの生活は常に監視の目に晒されることになりました.そしてそのカメラにAIが搭載されていた場合,私たちの情報はAIによって解析・識別されてしまいます.実際に中国では,そのようなAIを搭載したカメラによって個人を監視するようなシステムがある程度完成しています.

そのような社会では,私たちの情報は収集・解析されてしまい,私たちのプライバシーは大きく脅かされることになってしまいます.その中で,私たちはどのようにして自分のプライバシーを守れば良いのでしょうか?

その手段として,このプロジェクトではAIに誤認識されやすい服を制作しました.この服を纏うことで,AIを搭載した監視カメラによって人間と認識されなくなり,データ化され監視されてしまうことから逃れることができます.

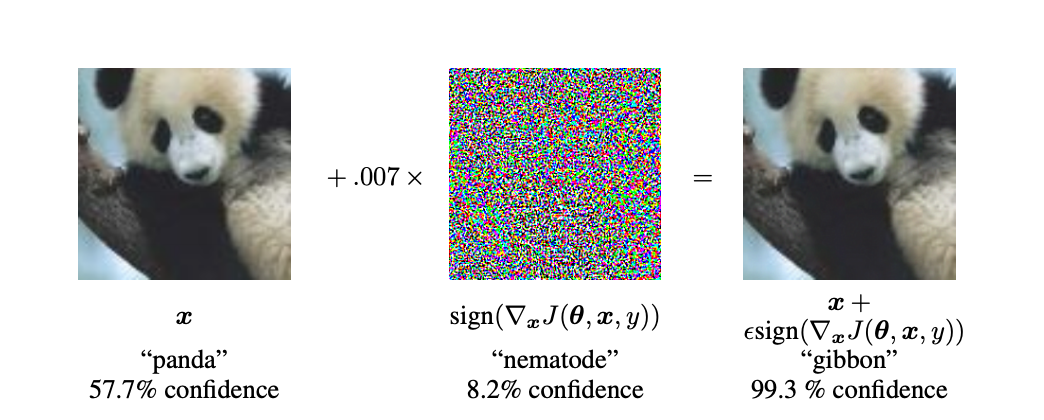

ベースとなっているのは,Adversarial Exampleという技術です.このAdversarial Exampleとは,簡単に言えば,AIに対する脆弱性攻撃のようなものです.説明としては,よく以下の画像が使用されます.

(「Explaining and Harnessing Adversarial Examples」より引用)

元々,左の画像は57.7%の確率でパンダとして認識されていました.この画像に微弱なノイズ(真ん中の画像)を加えた結果(右の画像),AIはこの画像を99.3%の確率でテナガザルとして認識しました.皆さんの目から見て,右の画像はテナガザルに見えるでしょうか?

このように,とある画像に対して,人の目には判別できないほどのノイズを加えることでAIを騙すことができてしまう事例が報告されており,Adversarial Exampleと呼ばれています.このAdversarial Exampleは画像に限らず,文章や音楽など他の領域においても報告されています.

その後,このAdversarial Exampleの考え方を応用したAdversarial Patchという手法が登場しました.以下の動画が,実際のデモ動画になります.

この動画では,YOLOv2という物体認識モデルを使用して,画面に映る物体が何であるかをリアルタイムに判別しています.何も持っていない男性はpersonとしてAIに認識されていますが,一枚の紙をもった男性はpersonとして認識されていません.この紙がAdversarial Patchです.このAdversarial Patchを持つことで,YOLOv2という物体認識AIからはpersonとして認識されなくなります.

そして,このAdversarial Patchを発展させてUNLABELEDが生まれました.Adversarial Patchのように,YOLOv2という物体認識AIから人としてされなくなる上,紙ではなく服を開発しました.服を開発したことにより,常に身に纏い街へと出かけることができるようになりました.

かつて,戦場にて身を隠すために迷彩柄が生み出されました.周りの景色と溶け込むような柄を見に纏うことで,自らの身を守っていたのです.あらゆる場所に監視カメラが設置されるようになった現代では,かつての戦場のように,監視カメラから自らの身を守る必要があります.その手段として,UNLABELEDのような現代の迷彩柄を見に纏う,といった方法も考えられるのでしょう.

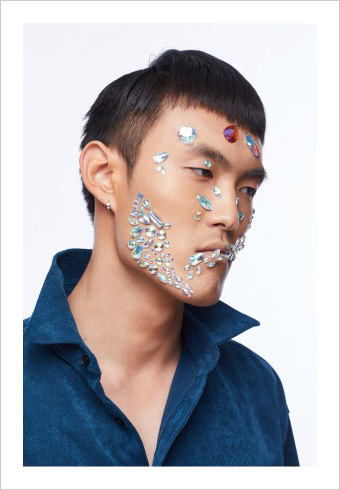

CV Dazzle

CV Dazzleは,Adam Harveyにより制作された,顔認識システムから逃れるためのヘアスタイル/メーキャップ術です.

先述したように,現代ではあらゆる場所にカメラが設置され,私たちのセキュリティやプライバシーは常に危険に晒されています.そのような状況下で,ヘアスタイルやメーキャップを使うことでカメラから自らを迷彩することを目的としています.

CV Dazzleでは,ダズル迷彩という迷彩をベースとしています.ダズル明細は第一次世界大戦中に多く見られた迷彩パターンで,艦船の船体外装に全面的・全体的に塗装して施されました.迷彩とは本来,周囲に溶け込むことを目的とするため,ダズル迷彩のような目立つパターンは一見逆効果のように思えます.しかし,ダズル迷彩においては敵艦隊の射撃システムを困惑させることを目的としているため,このような派手なパターンとなっています.つまり,何を目的とするかによって,迷彩のパターンというのも状況ごとに変化していくのです.

ダズル迷彩を施されたエンプレス・オブ・ロシア(1918年)(画像はWikipediaより引用)

このCV Dazzleは全ての顔認識アルゴリズムに対して機能するわけではなく,Viola-Jonesアルゴリズムを使用したアルゴリズムに対してのみうまく機能します.以下の動画は,Viola-Jonesアルゴリズムの実際の動作を視覚化したものです.

このアルゴリズムでは,長方形の領域ごとに計算を実行し,明るい領域と暗い領域の違いを分析します.その領域内に顔が存在するかどうか判別するためにさまざまなスケールでスキャンを実行し,顔があると認識された場合には赤い長方形でマークされます.そしてこの赤い長方形が複数個重なった場合にのみ,顔が存在すると認識されます.そのため,単に濃いメイクアップをするだけでは顔認識アルゴリズムを騙すことはできません.

そこでCV Dazzleは,前衛的なヘアスタイルやメーキャップを使い顔の連続性を隠しすことで,顔認識アルゴリズムを騙すことに成功しました.うまく騙すためのポイントとしては,左右を非対称にすることや,顔の輪郭を隠すことが効果的なようです.

この例では,髪型によって顔の輪郭は隠れ,さらに右頬のメイクによって顔の左右は非対称になっており,うまく顔認識アルゴリズムを騙すことができています.他にも,以下のようなパターンで成功を収めています.

(画像は https://cvdazzle.com/ より引用)

このようにCV Dazzleでは,顔認識アルゴリズムの特性を分析することで,逆に顔認識アルゴリズムを騙すことに成功しました.この作品は2012年の作品ですが,当時の段階ですでに監視カメラなどの普及に伴うセキュリティー/プライバシー侵害は大きな問題となっていたことがわかります.その対抗手段としてヘアスタイルやメーキャップを活用するという視点を見出したアーティストAdam Harveyの視点は大きな意義を持つでしょう.

INCOGNITE

INCOGNITEは顔認識システムから逃れるためのアクセサリです.

CV Dazzleと同様のコンセプトではありますが,眼鏡のように着脱可能である点でとても有用であると言えます.

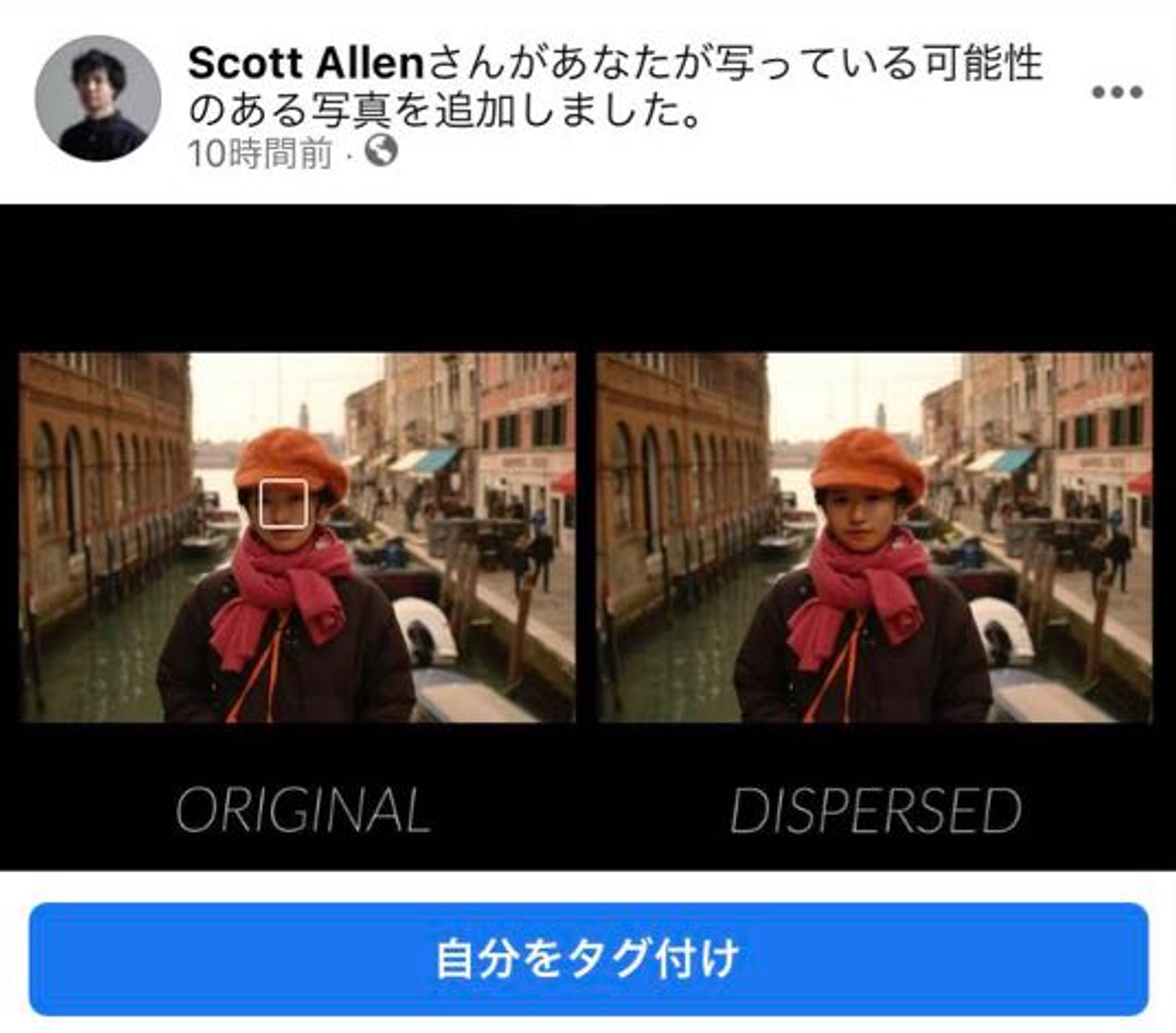

identity disperser -afforestation-

identity disperser -afforestation-は自分に似ているけど少し違う顔をSNS上に氾濫させて写真やアイデンティティの意味を揺らがせることを試みるプロジェクトです.実際に画像をSNSにアップロードすると,本人であると認識されなくなります.

How To Avoid Facial Recognition

この作品は,Kyle McDonaldとAram Barthollによる,アナログな方法で顔認識アルゴリズムを回避するための一連の方法の実験です.これまで紹介してきた事例では,デジタルな手法を用いて顔認識アルゴリズムを騙すような事例が多くありましたが,この作品では,誰でも実践可能なアナログな方法を模索している点が異なります.

まず,彼らは以下のようなマスクを装着します.この場合にはほとんど顔が見えないので,もちろん顔認識アルゴリズムを騙すことは容易いでしょう.

次に,透明なマスクを装着します.マスクが光を反射するため,顔認識アルゴリズムがきちんと動作しなくなるのでしょう.

そして最後に最もアナログで簡単な方法として,顔を傾けるという方法を紹介しています.特別な道具や準備は何も必要とせず,誰でも気軽に実践できるという点で,効果的であると言えるでしょう.

街中で皆で実践している様子.

こうした取り組み自体はとてもユーモラスに思え,監視社会というディストピア的な未来に対して,私たちができることは何があるのか,希望的な見地を与えてくれます.現在のAIをベースとした顔認識システムに対してはこの方法はうまく機能しない可能性はありますが,私たちの想像力次第で,新たな方法が発見されるかもしれません.

ARマーカーを認識させる

ARマーカーというのは特定のパターンが描画されているマーカーであり,このマーカーの種類や位置を検出することで様々な表現が可能になります.

Reactable

例えば,ReactableのようなARマーカーとプロジェクションマッピングを組み合わせた演奏装置のようなものもつくることができるでしょう.

OpenCV ArUcoで実装する

では,以下の動画を参考にTouchDesigner上で,ArUcoというOpenCVベースのARマーカーを生成し,それらを読み込んでみます.